常见问题

可以,通过 topic 按固定频率获取或者发布。

没有,自带的包只有对整个房间进行扫描建图 ,然后手动指定初始位姿和目标位姿或轨迹点,可以自动导航。

武汉京天电器有限公司有制作配套AI实验操作平台软件,可以在线实现巡线,巡墙,二维码识别,视觉跟随等功能。http://www.jingtianrobots.com/index.php?catid=35

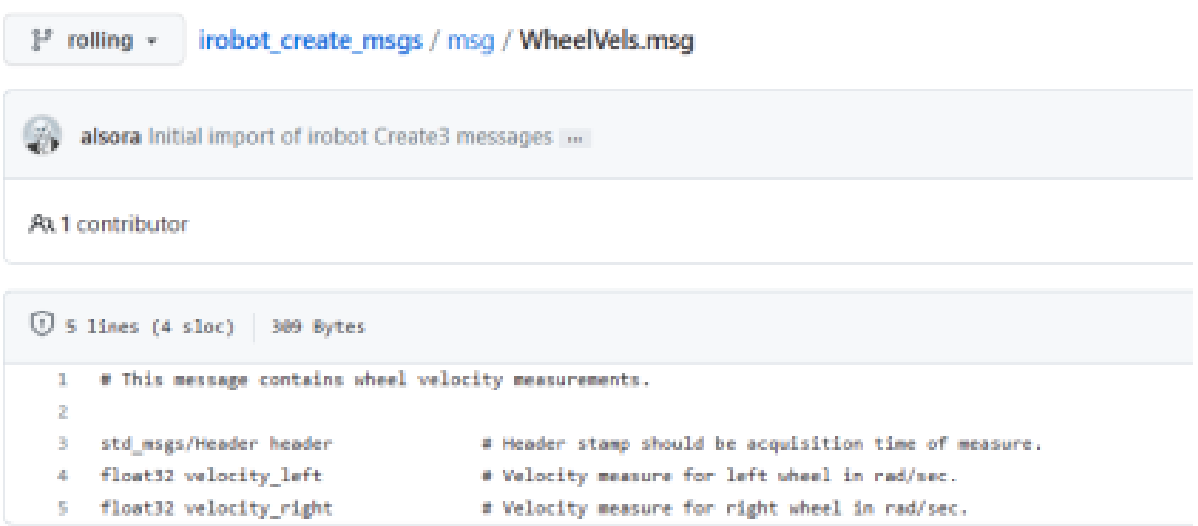

追问:检查了 wheel_vels 都是通的,有话题输出,但是雷达话题始终没有东西,我们远程到树莓派上运行了 ros2 launch turtlebot4_bringup rplidar.launch.py,但是也没有数据输出

A:你远程到树莓派上之后,雷达有输出吗?

追问:没有,双目相机的话题/stereo/depth 也没有输出

A:那可能是节点没有启动起来,重启一下看看

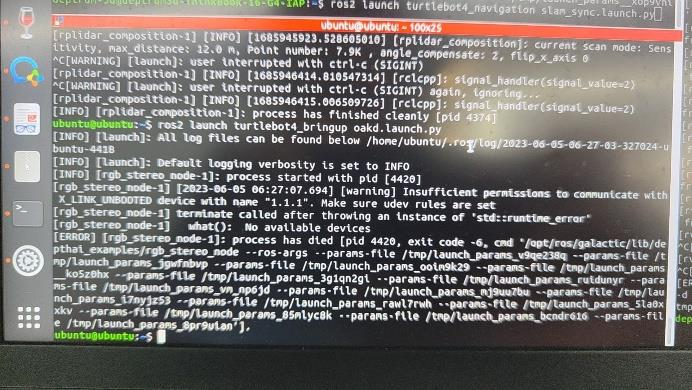

追问:雷达输出问题解决了,远程连接树莓派后重新启动了一下,不过双目相机没解决,有下面的报错,请问一下是怎么回事啊?

A:这个节点已经开机启动了,不用自己再手动启动,双目相机,你直接看一下画面有没有吧

追问:这个双目相机的 rviz 订阅/color/preview/image 没有图像是什么原因呢

A:你现在树莓派和 pc 都是连接的 5G 频段吗?树莓派上运行这个:sudo systemctl restart turtlebot4

然后 PC: ros2 run rqt_image_view rqt_image_view

sudo apt install ros-${ROS_DISTRO}-depthai ros

如果是galactic 的话:sudo apt install ros-galactic-depthai

追问:跑第二句会出问题

ATTRS{idVendor}=="03e7",

MODE="0666"' | sudo tee /etc/udev/rules.d/80-movidius.rules

sudo udevadm control --reload-rules && sudo udevadm trigger

追问:如何在树莓派上开热点,然后连接底盘和 PC 端来驱动

追问:这个参数除了 full 之外,还有那些可以选呢

http://www.turtlebot.net.cn/index.php?catid=74#pp119

针对 Turtebot4机器人的视觉避障开源代码主要是基于Turtebot4标配的视觉相机展开,应用实例详情见:

A:检查一下是否树莓派连接到了路由器的 5G 频段。底盘连到了路由器的 2.4G 频段。

追问:树莓派连上了,底盘没有连上

A:Create3 WiFi 配置:同时按下 CreateR3 按钮 1 和 2,直到光环变为蓝色。

Create3 现在处于 AP 模式。连接到名为"create-XXXX"的 WiFi 网络。在浏览器中转到 192.168.10.1,转到 connect 选项卡,输入您的 WiFi ssid 和密码,然后单击“connect”,等待它连接到 WiFi 并播放铃声。详情见用户手册页面:http://www.turtlebot.net.cn/index.php?catid=135#pp292

追问:192.168.10.1 进不去

A:PC 需要连接上名字包含 create 的网络。详情见用户手册页面:http://www.turtlebot.net.cn/index.php?catid=134

TB4机器人标配的OAK深度相机关于部署轻量化模型官网有比较好的生态。http://www.turtlebot.net.cn/index.php?id=144

比如目标检测可以用 mobilenet-ssd 模型,其中就包含 person 的检测,当然也有专门用于人物检测的模型,官网也提供了 linux环境下使用的 demo。不过具体怎么使用,比如如何调用 demo的相关接口,开发者可以自定义。

追问:那垂直方向是通过什么来获得数据的呢?

A:深度摄像头。深度摄像头相关信息可以查看http://www.turtlebot.net.cn/index.php?id=144

A:对于障碍物的距离和速度等信息,通常是通过使用合适的算法来从传感器数据中计算得出的,而实时获取障碍物的距离和速度取决于传感器的采样率和算法的计算速度。

追问:激光雷达和深度摄像头结合的话要做数据融合吗?

特征提取与匹配:通过提取激光雷达和深度摄像头的特征点,进行匹配和关联,以实现更准确的目标检测、跟踪和地图构建。数据融合可以提高环境感知的准确性、稳定性和鲁棒性,提供更全面和一致的感知结果。

具体的融合方法和算法选择会根据应用需求、硬件配置和算法实现等因素进行决定。

追问:这些融合算法里面自带么还是自己编写再去训练,我们重点是做决策优化的。

A:Turtlebot4 机器人目前还没有集成这些算法,只有简单的二维建图导航,但是关于传感器数据融合,还是有很多开源算法的,可以尝试移植。